VR

高通重磅推出首款5G擴增實境XR平台

高通(Qualcomm)Snapdragon XR2平台是全球第一個支援5G的延展實境(XR)平台,其連結高通技術公司的5G與人工智慧創新,以及XR技術,迎來行動運算新時代。此平台推出客製功能,更有許多能在擴增實境(AR)、虛擬實境(VR)與混合實境(MR)上擴展的創舉。

相較已被廣泛採用的高通XR平台,Snapdragon XR2平台效能全面顯著提升,提供2倍的CPU與GPU效能、4倍的影片頻寬、6倍的解析度,以及11倍的人工智慧效能。Snapdragon XR2平台是首款支援同步七鏡頭與專用電腦視覺處理器,也是第一個實現以低延遲鏡頭解開MR體驗的平台,讓使用者戴著VR裝置時看見、互動以及創造虛擬世界與真實世界的混合體。為了滿足真正身臨其境的XR的要求,此平台提供採用人工智慧基礎技術與5G連線能力的客製化影像表現、互動與音訊技術。

在視覺表現上,為在XR中體驗更逼真的真實感,就必須縮小現實世界與虛擬世界之間的視覺間隙,這需要先進的顯示器與繪圖處理能力。此平台在核心GPU處理能力上大躍進,為高效能圖形渲染支援1.5倍的像素速率與3倍的紋理速率。XR專有功能,例如眼動追蹤式注視點渲染技術、讓畫面更新率更順暢的增強型可變速率著色等,協助處理重度工作負載,同時維持低功耗。顯示面板能以90fps提供達3k×3k的單眼解析度,更支援60fps 8k 360度影片的XR平台,為串流與本機播放提供擬真的視覺表現。為了AR顯示器研發的客製矽晶降低整體系統延遲,維持AR體驗。

於互動性的表現,讓使用者能被瞬間傳送到全新環境。為精確有效做到,平台導入對同步七鏡頭與客製電腦視覺處理器的支援。同步多鏡頭能實現以高精準度即時一起追蹤頭部、唇部、眼睛,加上26個骨架點的手部追蹤技術。電腦視覺能提供高效率場景理解與3D重建。這些功能相互搭配後將讓使用者走入全新環境,在其中的數位世界憑直覺互動。

至於音訊部分,平台能在3D空間音效中提供全新等級的音訊層,同時透過無雜訊語音互動加深沉浸感。此平台搭載客製的內建常時啟動低功耗高通 Hexagon DSP,以支援語音啟動與情境偵測等硬體加速功能,助使用者在數位世界也能掌握真實世界的動靜。

人工智慧與5G是形塑通訊與運算未來的兩大技術。高通帶動兩大技術融入包含XR在內等行動運算領域。此平台多項功能皆已透過人工智慧提升效能,包含視覺表現、互動性、音訊,以便帶領使用者浸潤在實境中。平台是第一個支援5G連線能力的XR平台,有潛力釋放需低延遲與快速資料速率的創新XR體驗浪潮。如5G能利用裝置與邊緣雲間的拆分處理呈現擬真高品質體驗,實現真正無拘無束的XR,不受線路或空間限制。

Diodes首款HDMI 2.1線性轉接驅動器滿足視訊應用

Diodes發表業界首款HDMI 2.1通透線性轉接驅動器,並針對數位電視、筆電及桌上型電腦、VR裝置及遊戲機的功率及成本進行最佳化。此產品最高可支援 10K 視訊解析度。

PI3HDX12211是Diodes最新的HDMI線性轉接驅動器,也是業界首款符合 HDMI 2.1規格的產品。PI3HDX12211的每個通道最高支援12Gbit/s的速度,具備通道連結調訓、速率及編碼方面的透明度。本產品提供超低訊號延遲,可在高效能應用中確保優異的訊號完整性。

HDMI 2.1是HDMI的最新規格,可達到更高的視訊解析度及更新率。頻寬提升至48Gbit/s,因此可傳輸未壓縮的8K HDR視訊。PI3HDX12211的通透特性意味著該款轉接驅動器不受協議限制,可同時支援靜態和動態HDR。實作HDMI 2.1 的裝置可透過此介面傳輸靜態/動態HDR中繼資料。PI3HDX12211具備四個可編程線性等化、輸出振幅線性及平整增益的差分通道,可透過I2C介面或接腳設置進行控制。

PI3HDX12211以3.3V供電運作,每個通道功耗僅220mW,並可維持1,200mV 峰值至峰值的輸出振幅線性。隨著視訊解析度日益變高,PI3HDX12211可在筆記型和桌上型電腦、遊戲機、數位電視和機上盒、擴充塢及周邊裝置上帶來最新的視覺體驗。

腳底互動裝置助力 VR遊戲體驗身歷其境

因此,如果有了踩腳的壓力大小就可以分辨出在遊戲的過程中,是否以正常的走路亦或是躡手躡腳方式前進;再者,如果有了腳底各點的力大小,亦可形成一個方向的標示,也就可以得知使用者的行徑方向。

而作為一個熱衷於遊戲的玩家,多了一個感測器就像是多了一顆按鍵的鍵盤,只要有越多的不同的訊號輸入就可以越來越貼近人體操作。換言之,只要多了一對腳部感測裝置,就可以使VR裡的角色做出更多符合現實人體所做出的相對應動作。這也意味可讓遊戲往下一個真人模擬世代前進。

添加肢體感應強化VR遊戲體驗

隨著科技的進步,人們漸漸地意識到身體健康的重要性,但是工作的繁忙,使得大部分的人只有少數的假日,以至於沒有多餘的時間去安排一些運動活動。而這少數的假期又因為工作的勞累或是需要待在家裡陪伴親愛的家人,甚至是因為天氣太熱,變成了不想出門運動的理由。

因此,本文想利用薄膜壓力感測器製作可偵測腳底壓力的互動VR裝置,再配合遊戲的互動操作。這樣不僅可以和家人一起遊玩,也可以抒發工作所累積的壓力,更不用擔心因為天氣太熱而中暑,或是因為下雨而掃了興致。

同時,以往的遊戲是利用鍵盤滑鼠在螢幕上做操控,現在則是轉為手把及搖桿來當輸入裝置,並且螢幕輸出改為虛擬實境頭戴裝置,進而將遊戲產業提高的一個不同的層次。

不過,對遊戲玩家來說,虛擬實境遊戲雖能夠讓使用者以肉眼感受到遊戲世界,但跟現實的感知相比還是略有不足。例如,玩家只能在定點上玩遊戲,被追趕時,不能用使用現實雙腳來驅動遊戲內的角色跑步。因此,此設計將腳底壓力感測裝置加入操控器的一部分,藉此來實現可以與遊戲內的角色同步腳部動作,增添遊戲的樂趣。

換句話說,現在的VR遊戲日益增加,但市面上的遊戲使用介面大多以雙手感應來體驗遊戲,較少有其它的肢體感應。因此,為了追求更完善的體驗感覺,因而做出可以讓使用者使用雙腳的壓力與互動操控方式來提升遊戲樂趣的作品。以下列出本產品之相關特色:

.以往的VR裝置都是手部或頭穿戴裝置,腳部裝置很少。

.腳部感測裝置體積小且輕,可方便使用者穿戴。

.使用的感測器體積較薄,穿戴時不易有感覺異物。

.透過HID技術將感測結果轉為鍵盤的指令,不必再安裝其他程式分析指令。

.藉由九軸和腳底壓力感測器來感測使用者行走的方向、速度或模式。

.Unity遊戲內的角色透過接收裝置的指令作出與使用者相似的行動。

.腳部感測裝置能充電並非一次性使用。

.安裝腳底壓力感測裝置的鞋墊可藉由裁剪符合使用者的腳部大小。

.腳部感測裝置利用RF傳輸資料,方便架設與使用。

腳底互動裝置設計要素

本產品使用盛群旗下的HT66F2390與UART、SPI、I²C、HID、FSR與九軸感測器等元件與技術,以下將一一說明。

UART串列介面

UART是一種通用非同步收發傳輸器,通常稱作UART,是電腦硬體的一部分,可將資料由串列通訊與並列通訊間作傳輸轉換。UART通常用在與其他通訊協定(如EIA RS-232)的連結上。在串列傳輸通訊協定的格式內容,每一個符號由四種資料共11個位元所組成,共分為:

.起始位元(Start Bit)

.資料內容(Data)

.奇偶同位元檢查碼(Priority Bit)

.停止位元(Stop Bit)

如圖1所示,資料透過FIFO(First Input First Output)的方式,由最低有效位元LSB(Least Significant Bit)開始傳輸直至最高有效位元MSB(Most Significant Bit),但奇偶同位元(PB)可以選擇忽略不使用。

圖1 UART資料傳輸格式示意圖

SPI 串列介面

SPI為一主從式架構,通常有一個主機端(Master)和一或多個隨從端(Slave),連接方法及內部硬體構造如下圖2所示;而SPI工作模式一共4種,其詳細的時序圖可參考圖3所示:

圖2 SPI硬體構造圖

圖3 各種工作模式下的SPI時序圖

其中,圖3的SCLK可藉由軟體定義CPOL=0或1,並分別使SCLK在不工作時,準位保持在0或1。而CPHA可控制Master的SPI暫存器讀值或傳值在SCLK的正緣或負緣觸發。

在一般的情況下,Slave只會支援一種工作模式。因此,Master端必須要把工作模式設定成與Slave端一樣,並且事先確認Master與Slave是使用相同的模式進行操作。

目前較常用的操作模式為1或3。此外,還須注意SS訊號負緣對於大多數的Slave晶片使用來識別Master送來的第一個bit,所以盡量不是直接把SS接地。

I2C串列介面

I2C串列傳輸包括四個部分:起始訊號、設備位址發送、數據傳送和停止訊號。相關特性如下所列:

.只能Master<->Slave,無法Slave<->Slave,每個Slave都要有一個特定且唯一的位址。

.START狀態:SCL=High且SDA為負緣。

.STOP狀態::SCL=High且SDA=為正緣。

由Master發送起始訊號來開始通訊,所有的Slave Device接收到起始訊號後會進入接收數據模式。緊接著,Master需要發送通訊目標設備的位址及R/W資訊。目前的規範是提供兩種位址模式:7-bit和10-bit。

此外,須注意的是,只能Master<->Slave,無法Slave<->Slave,每個Slave都要有一個特定且唯一的位址,且由Master發送起始訊號來開起通訊,所有的Slave裝置接收到起始訊號後會進入接收數據模式。緊接著,Master需要發送通訊目標設備的位址及R/W資訊。

Unity軟體

Unity軟體是一套跨平台的遊戲引擎,可開發執行於PC、Mac OS單機遊戲,或是iOS、Android手機或平板電腦的遊戲。Unity也可開發線上遊戲,只需在網頁瀏覽器安裝外掛程式後即可執行Unity開發的遊戲。此外,Unity亦可用於開發PS3、XBox360、Wii遊戲主機上的遊戲。

本團隊利用免付費的模組及資源來設計能與本系統配合之遊戲。其中,Unity能藉由C#抓取鍵盤所傳送的按鍵值,藉由模擬鍵盤來操作遊戲中的角色,並將遊戲中的溫度、振動與電擊等,回傳到具備互動操作的手套,實現超越一般「虛實」體驗與體感互動系統設計的功能。

USB HID人機介面裝置

USB HID設備是直接與人互動的設備,例如鍵盤、滑鼠與搖桿等,具有以下功能。

.模擬鍵盤、滑鼠輸入指令。

.不需加裝其他特殊驅動程式,裝置插上即可使用。

.能遊玩眾多使用鍵盤及滑鼠操作之遊戲。

.可提供跨平台之操作,方便安裝與移植。

腳底壓力感測器

圖4為力敏電阻(FSR)工作原理,腳底壓力感測器是由3片FSR組成,其功能為:

圖4 FSR 工作原理圖

.是一個可以根據受力大小產生不同電阻變化的元件。

.隨著力量的增大,電阻會逐漸變小。

.力量和電導(conductance=1/r)成正比。

九軸感測器

九軸感測器共包括三軸加速度計、三軸陀螺儀、三軸磁力計,其中,三軸加速度計與三軸陀螺儀說明如下。

根據牛頓第二定律,物體加速度(m/s2)與受到的合力(N)成正比,與其質量(kg)成反比,而加速度方向與合力相同。值得注意的是,加速度計的作用力檢測機制擷取了作用力產生的加速度,所以加速度計實際測量的是力,而不是加速度。也即是加速度計是藉由檢測施加在其中一個軸向的作用力來間接測量加速度。

加速度計也是一種包括孔、空腔、彈簧和通道等以MEMS微型製造加工的機電裝置。而加速度計採用多層晶圓製程,以物體重心相對於固定電極的位移來測量加速力。

陀螺儀是一種用來感測與維持方向的裝置,基於角動量不滅的理論設計出來的。陀螺儀主要是由一個位於軸心可以旋轉的輪子所構成,陀螺儀一旦開始旋轉,由於輪子的角動量,陀螺儀有抗拒方向改變的趨向。而陀螺儀多用於導航、定位等系統。

無線收發晶片NRF24L01

NRF24L01是一款工作在2.4~2.5GHz世界通用ISM頻段的收發晶片模組,最大0dBm發射功率,在空曠的地方進行傳輸時,則可以達到100公尺的傳輸距離,並且支援六通道的資料接收。以下,為此模組的基本規格:

.工作電壓(Vcc):1.9~3.6V,建議3.3V。

.發送模式下,電流耗量(0dBm時):11.3mA。

.接收模式下,電流消耗(傳輸率2Mbps時):12.3mA。

.內置2.5G天線,體積輕小。

.當工作在應答模式通訊時,快速的空中傳輸及啟動時間,極大的降低電流消耗。

.具有自動重發功能,可由軟體控制重發次數及重發間隔時間。

.在接收到有效資料後,模組自動發送應達訊號,減少單晶片進行程式檢測時間。

腳底互動裝置結構解析

如圖5所示,是本產品方塊示意圖。本產品採用盛群的HT66F2390 MCU作為腳部感測裝置的核心元件,且在腳部(左腳與右腳)感測裝置有鋰電池可以供電給HT66F2390和NRF24L01模組。

圖5 整體系統方塊示意圖

其中,分別使用HT66F2390的ADC、I2C、GPIO及SPI的介面功能,並且分別讀取腳底壓力感測器、控制九軸感測器與NRF24L01。

如圖6所示,為本系統之硬體架構圖。發送端的腳步裝置包含左右腳部分,都是由HT66F2390、九軸感測器、壓力感測器及NRF24L01元件所組成。

圖6 整體硬體架構示意圖

其中,HT66F2390將會透過I2C介面讀取九軸感測器的數值,以及使用ADC的方式讀取壓力感測器的數值。最後,將這些資料整理存入陣列後,由SPI將資料送給NRF24L01,再由NRF24L01將資料發送給接收端。相對地,接收端則利用NRF24L01來接收從腳底壓力感測裝置所傳出的資料並加以進行判斷,爾後再將相符的鍵值透過USB HID介面傳送至遊戲中控制。

如圖7所示,為腳部感測裝置的電路Layout圖。將NRF24L01置於最右側執行無線傳輸,並將開關、LED、micro USB放置於左下角,便於操作,而實際整體電路板則是放置在鞋墊邊緣,以方便操作。圖8為本作品軟體流程圖。當遊戲一開始,首先判斷玩家所踩踏出之壓力數值來模擬遊戲上的動作,使玩家在遊戲裡的角色得以移動,經過層層闖關及完成挑戰。

圖7 腳底壓力感測裝置的電路layout圖

圖8 腳步感測裝置之NT66F2390系統流程圖

驗證/測試確保腳部感測裝置順利運作

本產品是透過NRF24L01之間互傳資料,並使用HID技術將資料轉為鍵盤的指令,而相關的執行結果先由UART觀察是否正確以避免錯誤的數據傳輸,實際測試方法如下所列。

腳部感測裝置是將九軸感測器與腳底壓力感測器透過NRF24L01傳給PC主機的接收端。而為了確保資料正確接收,於是透過UART將NRF24L01所收到的資料利用XCTU顯示。

圖9為NRF24L01之間互傳資料示意圖,其中,傳送的資料共11bytes,依順序為九軸感測器的加速度計X、Y、Z軸、陀螺儀的X、Y、Z軸、腳底壓力感測器的壓力數值以及左右腳符號與換行符號。

圖9 NRF24L01之間互傳資料示意圖

如圖10所示,使用I2C傳輸協定來對九軸進行讀取與寫入暫存器的動作。首先,要先傳九軸的地址並加上是要讀取還是寫入,緊接著,九軸會回傳一個ACK的訊號,代表它接收到了。緊接著,就可以繼續之後的動作,看是要寫入或是讀取暫存器,並使用孕龍分析儀檢測傳輸的資料是否正確。

圖10 MPU9250傳輸格式示意圖

當PC主機的接收端收到資料後,將進行資料的判斷,並依照判斷的結果透過USB HID將相符合的鍵值送入到遊戲軟體中。其中,如圖11所示,利用XCTU來顯示由USB HID傳入的鍵值。

圖11 USB HID技術模擬鍵盤的指令畫面圖

當腳部感測裝置沒電時,可利用micro...

數位實境溝通更直覺 穿戴裝置UI眼球追蹤最懂

一個明星終端商品的發展,軟硬體技術的到位與產業環境的配合非常重要,以UI為例,PC使用鍵盤與滑鼠、Smart Phone透過手勢觸控,未來希望解放雙手的穿戴式裝置,可能需要仰賴語音與眼球控制。眼睛是靈魂之窗,一般人際溝通會大量使用眼睛,大部分的動作之前也都是眼神先到位,透過視覺與聽覺傳達的影像和聲音才是最直觀、最常用的溝通方式。

穿戴裝置將導入眼球追蹤控制

兩個有默契的人一般只要閱讀「眼神」就能進行溝通,人們對於資訊產品的使用已經朝無時無刻與無所不在發展,穿戴式裝置希望可以讓使用者在做任何事的同時也可以同步使用,見臻科技(Ganzin)執行長簡韶逸認為,智慧手機市場已趨於飽和,廠商紛紛尋求新產品,加上5G的出現,也讓大家開始思考手機以外的應用,智慧眼鏡可能就是答案。預計2020年將會有更多智慧眼鏡問世,光機技術的成熟也是智慧眼鏡市場可能在2020年爆發的推力之一,過去光機沒有辦法做到現在這麼小,隨著技術成熟,微小化光機更有機會整合在眼鏡上面。

人類的視覺有焦點,在焦點以外的事物相對模糊,因此在穿戴式裝置的應用上,簡韶逸指出,利用注視點渲染技術(Foveated Rendering),追蹤人眼的焦點位置,只在焦點位置進行高解析度影像運算與顯示,節省其他90%以上的運算資源,同時使用者並不會有明顯的感受,也就表示,GPU效能不用很高就可以有超高解析度的表現,此技術對於未來智慧眼鏡的顯示,將造成重大的影響。

智慧手機讓我們使用資訊產品不用固定在桌椅上,但在行走或做事時還是無法使用,見臻希望可以解放這個限制,讓眼球追蹤功能普及在人們的生活之中。簡韶逸進一步說明,現有眼球追蹤(Eye Tracking)技術目前多數成本高、體積大、耗電且很難整合;以知名的解決方案為例,使用七顆LED照射眼部,利用光線反射原理追蹤眼球的移動,但是一出室外,環境光太強,該技術效能就會大打折扣,同時需要搭配大電量電池,使用時間僅1.5小時。

眼神控制新UI為終極目標

因此,眼球追蹤技術目前普及的困難在於耗電、成本、整合等面向,為了解決這些問題,簡韶逸進一步說明,見臻推出眼球追蹤技術解決方案Aurora,用兩顆CMOS感測器及一顆眼睛處理單元(EPU),使用外接電源的情況下續航力高達十個小時,機構簡單封裝小,相當容易整合。

另外,Aurora只用一顆LED補光,利用感測器拍攝眼球的動作變化,可以避免環境光源干擾,所以室內外都能使用,同時減少LED數量更可以大幅降低耗電量。

眼球追蹤技術的使用願景其實已經出現,在電影鋼鐵人中,主角就是透過眼神操控高科技的機器鎧甲,簡韶逸解釋,人類視覺用眼球追蹤大約是中央區正負15度的區間,再大就會轉頭,在這區間中精準度小於1度,目前的技術要做到像電影裡的準確度與複雜控制還有一段距離,不過就技術的發展來看,再過幾年技術改善相當有機會達成。

簡韶逸指出,眼球追蹤技術應該是像PC的滑鼠那樣的輔助角色,整合在裝置裡,占整個裝置成本的10~20%才是合理範圍,見臻的解決方案能加速技術的普及;該公司於2019年初發表第一代解決方案,後續提供工程樣品給客戶,並進行客製化的設計,預計2019第四季正式量產。Aurora的晶片雖然是見臻自行開發的產品,但團隊並不以IC設計公司自居,而是定位為軟硬體整合解決方案供應商,因為是從學校出來的團隊,每個工程師都會做演算法和硬體,所以不會有演算法跟晶片電路無法搭配的問題。

在全世界各地很難再有像台灣一樣,從台北到新竹這麼短的距離就可以找到軟體、硬體設計,晶圓、終端代工,甚至品牌與各種類型的科技解決方案廠商,台灣非常適合發展創意與新創產業,Ganzin這個名字源自台語的「眼神」,也取英文gaze的凝視之意,簡韶逸期許見臻不只做到眼球追蹤,更做到「眼神控制」,讓科技更符合人性。

見臻科技執行長簡韶逸認為,預計2020年將會有更多智慧眼鏡問世,光機技術成熟,微小化光機更有機會整合在眼鏡上面。

開啟直覺人機互動新篇章 高整合140GHz雷達系統顯威

比利時奈米電子和數位科技研究與創新中心imec,5月14、15日於安特衛普(Antwerp)法蘭德斯會議中心舉辦年度科技盛會「Future Summits」,活動除邀請英特爾(Intel)技術長Mike Mayberry、益華電腦(Cadence Design Systems)執行長陳立武、微軟(Microsoft)HoloLens硬體與客製晶片副總裁Ilan Spillinger、嬌生公司全球負責人William Hait、WD執行長Stephen Milligan,以及美光科技(Micron)技術策略與營運副總裁Linda Somerville等多位產業界重量級人物分享創新科技思維與觀點外,亦展示超過50多項imec與合作夥伴共同研發的技術與應用成果,堪稱科技界最具指標性的前瞻技術交流平台。

在眾多展示成果中,採用140GHz頻段的多重輸入輸出(MIMO)雷達單晶片方案,格外令人注意,除了使用的毫米波(mmWave)頻段更高外,其採用CMOS技術高度整合多天線與收發器,實現精巧、小尺寸設計,亦是一大特點;再結合imec研發的機器學習演算法,可達到超精準解析度與高靈敏感測效能,為雷達感測在直覺式人機互動的應用發展再寫新頁。

5G/自駕車熱潮帶動 雷達感測應用前景俏

近來,隨著5G與自駕車發展日益升溫,毫米波技術的應用潛力逐漸受到產業界重視,相關研發活動與投資也不斷增加,除了聚焦在5G高頻通訊與汽車駕駛輔助系統(ADAS)的雷達應用外,利用毫米波雷達實現更多元的感測應用,亦是另一個重要發展方向。

舉例來說,德州儀器(TI)除了力推車用毫米波雷達方案外,亦積極將該技術拓展至工業自動化、智慧建築、智慧監控等其他應用領域,利用60GHz高頻毫米波雷達實現如人員計算、動作偵測、使用狀態偵測(Occupancy Detection)及生命跡象監測等應用。此外,英飛凌(Infineon)、Acconeer、Silicon Radar、NOVELIC等歐洲晶片廠,也都朝同樣的方向發展,甚至已推出基於60GHz毫米波雷達的感測方案。

事實上,目前上也有不少廠商是以24GHz毫米波雷達方案,來拓展上述非汽車ADAS應用的雷達感測市場,不過,由於業界已傳出歐洲電信標準協會(ETSI)和美國聯邦傳播委員會(FCC)決定於2022年前,逐步淘汰使用24GHz超寬頻段(Ultra Wide Band)的產品,再加上基於60GHz頻段的毫米波雷達,本質上可提供比24GHz頻段更高的感測解析度,因此不少廠商已開始往60GHz技術靠攏。

至於汽車雷達常用的77GHz頻段,若要用於工業、建築和城市基礎建設,包括那些需要人機互動的應用,在全球大多數地區都是受到限制的。

頻寬決定距離解析度 140GHz方案來勢洶洶

值得注意的是,毫米波雷達感測器的距離解析度(Range Resolution)效能與使用頻段的頻寬大小息息相關,頻率愈高頻寬也相對較大,意味著感測器距離解析度愈好,因此目前已有業者推出採用120GHz頻段的毫米波雷達感測器,而imec此次所發表的140GHz毫米波雷達系統單晶片,則是另一突破性的技術進展。

以60GHz頻段來說,根據德州儀器所提供的產品資料顯示,頻寬上看4GHz,因此基於該頻段的雷達感測器距離解析度可達3.75公分;而根據imec的規格表來看,140GHz頻段的頻寬可高達10GHz,距離解析度則可到1.5公分等級(表1),而距離解析度愈小代表雷達感測後所能獲得的點雲圖資料(Point-cloud Data)可以更密,進而達到更精準的判斷效能。

imec研發團隊負責人Andy Dewilde說明,imec長久以來在CMOS技術的開發與多天線整合設計上擁有相當厚實的能力與經驗,因此能在一個外觀尺寸只有幾平方公分的完整MIMO雷達系統下,實現1.5公分的精準解析度。而更好的距離解析度性能,可開啟更多新的應用機會,這是該公司140GHz雷達系統單晶片重要的差異化特色之一。

Dewilde進一步談到,使用140GHz頻段的另一個明顯好處是,電磁波波長更小,僅2.1毫米,換言之,天線也就可以做得很小,因而imec僅透過28奈米Bulk CMOS製程技術,即可將天線直接整合至單晶片中,毋須使用昂貴的天線模組或外部天線,達到更高整合度與小尺寸設計,且未來也可輕易藉由大量量產來達到降低成本目標。

不僅如此,高頻毫米波波長小的特性,也可偵測到更小的位移變異,如細微的臉部表情變化與皮膚運動,能顯著提升位移靈敏度,有助於生命體徵偵測等應用,因此該雷達是實現車內生命體徵監測系統極佳的方案,可促成非接觸式駕駛狀況追蹤,例如偵測駕駛有沒有打瞌睡、壓力狀況是否異常,或者預防因急性健康危害如心臟疾病或癲癇發作。另一個可能應用,是利用動作和生命體徵偵測來監測小孩狀況,例如當兒童不小心被留在車內時發出警報,即使當下是嬰兒蓋著毯子睡覺,該雷達感測器也可發揮作用。

結合MIMO/機器學習 打造直覺人機互動體驗

除了140GHz高頻毫米波頻段所帶來的技術優勢外,imec也在該款雷達晶片中,加入MIMO多天線配置與機器學習能力,從而打造直覺簡單的人機互動介面。

以手勢辨識來說,其需要最小角度解析度以便能在三度空間中擷取手勢,而提升角度解析度的一個巧妙方式,是使用多顆收發器晶片的MIMO雷達原理。Dewilde說明,MIMO是為了手勢辨識而設置,藉此可達到更精確的角度解析,以正確解讀目標物相對於雷達的方向。而訊號處理與機器學習技術亦是用來偵測和分類手勢動作,從而實現直覺式人機互動。

事實上,imec已開發出一種特定的機器學習演算法,是基於一個包含長短期記憶模型(LSTM)層的多層神經網路,並透過監督式學習方式,亦即使用超過25人的內部標籤記錄(包括針對7種不同手勢的幾次擷取記錄),來訓練推論模型。實驗結果顯示,該模型可對記錄的7種手勢進行分類,且94%的時間可正確預測手勢。

imec荷蘭雷達專案研發經理Barend van Liempd指出,藉由加入機器學習能力,imec已證明雷達基於都卜勒(Doppler)訊息來偵測和分類細微動作的可行性,這將開啟新的應用機會,如實現直覺的手勢辨識人機互動。以擴增實境/虛擬實境(AR/VR)應用來說,新的雷達方案就可支援與虛擬物件的直覺式互動,手勢辨識還可以實現直覺的裝置控制,與現今語音控制或智慧觸控螢幕的人機介面相輔相成。

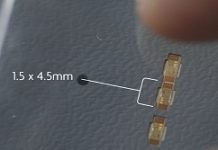

據了解,imec所研發的140GHz雷達晶片方案主要適用於室內的應用,操作範圍可達10公尺,且尺寸極為小巧,單一晶片大小僅1.5×4.5mm(圖1),可在幾乎各種裝置中被無形地整合,諸如筆電、智慧手機或螢幕邊框。

圖1 imec所研發的140GHz雷達單晶片尺寸僅1.45mm×4.52mm

圖片來源:imec

imec表示,該款雷達晶片初期將用於智慧建築的人員偵測和分類、遠端汽車駕駛生命跡象監測,以及手勢辨識等應用;而更多的創新應用預期將隨著開發者的創意不斷湧現。

邁向更高整合/增強感測性能

目前imec的140GHz雷達開放創新研發合作計畫,主要係由Panasonic和Sony所支持,對該項研究有興趣的公司也可加入這項合作計畫,或另外的雙邊研發計畫,或者取得該技術功能區塊的授權。

為了增加感測數據的豐富性和空間資訊,imec已著手開發下一代採用4×4的MIMO雷達系統,以及新的雷達晶片(將採用Tx和Rx是分離的兩顆獨立晶片的設計)。這將使MIMO陣列元件在可用電路板區域的分布更有彈性。同時他們也將探索獨立的雷達晶片功能能否被增加,以實現擁有更大晶片陣列的MIMO系統。

Dewilde指出,此次在Future Summits展出的140GHz雷達系統原型(圖2),採用的是2×2 MIMO設計,所以只能做一個方向的角度偵測,下一個系統,會使用新版晶片,預計研發4×4 MIMO,有更多天線,以達到3D偵測。

圖2 imec研發團隊負責人Andy Dewilde利用imec 140GHz雷達系統原型,展示手勢辨識應用。

毫米波雷達感測有可為

與其他類型的動作感測技術相比,例如基於飛時測距(Time-of-flight,...

信驊獨門影像拼接方案助攻 360相機掀4K即時串流風

360度全景攝影機技術規格大躍進。伺服器管理晶片大廠信驊科技跨足360度全景影像處理晶片有成,其所研發的晶片內影像拼接(In-camera Stitching)專利技術,能讓消費性360度全景攝影機實現4K影片即時串流,而毋須透過電腦進行後製轉檔,可望促成消費性360相機的全面升級,擴大4K 360影片即時串流與直播應用新熱潮。

信驊科技360度全景影像處理晶片,採硬體電路方式實作影像拼接演算,讓消費性360相機毋須再透過PC後製,就可即時串流4K 360影片。

看好VR與360度全景攝影機發展前景,信驊自3年多前即開始積極布局,並藉由收購影像相關矽智財(IP)切入360度全景攝影機影像處理晶片市場,歷經2年多潛心研發,2018年成功以專利技術打造出首款以硬體電路方式實作拼接演算法的影像處理晶片Cupola360,為消費性360度全景攝影機實現4K即時影像拼接,帶來新的發展契機。

信驊科技產品開發部經理周辰威表示,今年台北國際電腦展(Computex),信驊再乘勝追擊,不僅演算法更加精進,晶片規格也提升至可支援6顆500萬畫素鏡頭,讓影片解析度可達5.7K,相片解析度達8K(3,000萬畫素),並且可支援RTMP/RTSP等即時串流協定,讓合作廠商更容易進行開發。同時,該公司也開發出基於雙鏡頭180度影像處理晶片的居家/公共監控系統;基於4鏡頭360度全景影像處理晶片的視訊會議系統;以及基於6顆鏡頭360度全景影像處理晶片的消費性360度攝影機,展示各種可能的應用情境。

周辰威指出,Cupola360是以硬體電路方式實現晶片內影像拼接,由於演算法設計獨到,因此只須使用一般規格的ARM架構處理器,即可達成即時360影片串流與直播,且同時兼顧效能與耗電量。他進一步強調,市面上360度全景攝影機就算用PC做拼接,一分鐘的影像轉成一分鐘拼接好的影片,至少要花四分鐘以上,而藉由Cupola360方案,能做到即時拼接,讓使用者拍攝完後就可上傳Youtube等平台,而毋須再透過PC轉檔處理。

值得一提的是,信驊Cupola360影像處理晶片,只需6顆鏡頭一般廣角鏡頭(120度),即可實現4K全景影片串流直播,這意味著,全景攝影機製造商可以用相對便宜的廣角鏡頭來進行開發,而毋須用到魚眼鏡頭,因此整體成本也可以更有競爭力。

據悉,信驊在消費性360度全景攝影機方面,已有成功的合作案,並已開始貢獻營收,很多廠商都已緊鑼密鼓在開發產品,如台灣新創公司dp smart即採用Cupola360開發產品ROGY,並已在Kickstarter成功募資,預計2019年9月開始出貨。

周辰威透露,下一代晶片設計目標,是將即時拼接影像的解析度等級提升至8K,而不透過PC後製,同時增強人工智慧(AI)、防手震等功能;而為達此一目標,除將持續精進演算法外,也會從系統開發的每個環節進行優化。

另外,信驊也相當著力於產業生態的建立。周辰威指出,該公司不僅擁有硬體晶片方案,也提供完整APP行動應用軟體,讓開發商毋須自行投入人力研發,並希望藉此凝聚使用社群。未來,將致力協助客戶實現更多應用,以建立完整的360全景攝影應用生態體系,促進VR產業的蓬勃發展。

手勢/心跳皆可偵測 140GHz MIMO雷達超有感

比利時奈米電子和數位科技研究與創新中心imec,發布以28奈米CMOS技術打造的140GHz MIMO雷達單晶片,能在兼顧小尺寸、低成本、低功耗前提下,實現更高解析度與靈敏度,可望進一步擴展毫米波雷達在手勢辨識、生命體徵監測與細微運動偵測等領域的應用版圖。

隨著5G與自駕車發展日益升溫,毫米波技術的應用潛力逐漸受到產業界重視,相關研發活動與投資也不斷增加,除了聚焦在5G高頻通訊與汽車駕駛輔助系統(ADAS)的雷達應用外,利用毫米波雷達實現更多元的感測應用,亦是另一個重要發展方向。

針對非汽車ADAS的雷達感測應用,目前市場上以60GHz毫米波雷達方案為主,而imec此次所發表的140GHz毫米波雷達單晶片,則是另一突破性的技術進展。

imec研發團隊負責人Andy Dewilde說明,imec長久以來在CMOS技術的開發與多天線整合設計上擁有相當厚實的能力與經驗,因此能在一個外觀尺寸只有幾平方公分的完整MIMO雷達系統下,實現1.5公分的精準解析度。而更好的距離解析度性能,可開啟更多新的應用機會,這是該公司140GHz雷達系統單晶片重要的差異化特色之一。

Dewilde進一步談到,使用140GHz頻段的另一個明顯好處是,電磁波波長更小,僅2.1毫米,換言之,天線也就可以做得很小,因而imec僅透過28奈米Bulk CMOS製程技術,即可將天線直接整合至單晶片中,毋須使用昂貴的天線模組或外部天線,達到更高整合度與小尺寸設計,且未來也可輕易藉由大量量產來達到降低成本目標。

不僅如此,高頻毫米波波長小的特性,也可偵測到更小的位移變異,如細微的臉部表情變化與皮膚運動,能顯著提升位移靈敏度,有助於生命體徵偵測等應用,因此該雷達是實現車內生命體徵監測系統極佳的方案,可促成非接觸式駕駛狀況追蹤,例如偵測駕駛有沒有打瞌睡、壓力狀況是否異常,或者預防因急性健康危害如心臟疾病或癲癇發作。另一個可能應用,是利用動作和生命體徵偵測來監測小孩狀況,例如當兒童不小心被留在車內時發出警報,即使當下是嬰兒蓋著毯子睡覺,該雷達感測器也可發揮作用。

除了140GHz高頻毫米波頻段所帶來的技術優勢外,imec也在該款雷達晶片中,加入MIMO多天線配置與機器學習能力,從而打造直覺簡單的人機互動介面。imec荷蘭雷達專案研發經理Barend van Liempd指出,藉由加入機器學習能力,imec已證明雷達基於都卜勒(Doppler)訊息來偵測和分類細微動作的可行性,這將開啟新的應用機會,如實現直覺的手勢辨識人機互動。以擴增實境/虛擬實境(AR/VR)應用來說,新的雷達方案就可支援與虛擬物件的直覺式互動,手勢辨識還可以實現直覺的裝置控制,與現今語音控制或智慧觸控螢幕的人機介面相輔相成。

據了解,imec所研發的140GHz雷達晶片方案主要適用於室內的應用,操作範圍可達10公尺,且尺寸極為小巧,單一晶片大小僅1.5x4.5mm,可在幾乎各種裝置中被無形地整合,諸如筆電、智慧手機或螢幕邊框。

為了增加數據的豐富性和空間資訊,imec已著手開發下一代採用4x4的MIMO雷達系統,以及新的雷達晶片。Dewilde指出,目前的140GHz雷達系統原型,採用的是2x2 MIMO設計,所以只能做一個方向的角度偵測,下一個系統,會使用新版晶片,預計研發4x4 MIMO,有更多天線,以達到3D偵測。

imec研發團隊負責人Andy Dewilde利用imec 140GHz雷達系統原型,展示手勢辨識應用。

信驊科技於Computex展出全系列Cupola360影像處理晶片

全球第一大遠端伺服器管理晶片供應商-信驊科技(ASPEED)於台北國際電腦展(Computex 2019),展出Cupola360全系列影像處理晶片應用。延伸去年發表的Cupola360六鏡頭全景影像處理晶片,將其獨家晶片內影像拼接技術(In-camera Stitching)優勢發揮到極致,依客戶及市場需求提供各種數量鏡頭組合之影像處理晶片,包括:家用/公共監視系統專用-雙鏡頭180度影像晶片;視訊會議設備專用-四鏡頭360度環景影像晶片;以及消費型360攝影機專用-六鏡頭360度全景影像晶片,全產品線備齊,展現該公司積極投入影像處理晶片領域的決心。

針對家用/公共監視系統市場,信驊科技展出雙鏡頭180度影像處理晶片;搭配兩顆高畫質5Megapixel廣角鏡頭以及晶片內影像拼接演算技術,可達水平180度/垂直95度可視範圍(FOV)及4K高解析度照片;廣角鏡頭可以避開傳統魚眼鏡頭邊緣解析度低等問題,即使在邊緣處局部格放依然清晰,任何細節都不錯過。

針對視訊會議應用則展出四鏡頭360度環景影像處理晶片;採用四顆廣角鏡頭平均分佈四周設計,完全覆蓋360度水平環景影像,恰好符合視訊會議需求,並且能大幅改善傳統魚眼鏡頭影像扭曲模糊等缺點,影像品質優越;搭配一系列AI功能,能精準定位格放並切換講者,會議進行更加流暢。

至於消費性應用市場,則主推Cupola360六鏡頭全景360度影像處理晶片;今年規格提升至6顆5Megapixel大像素鏡頭,相片解析度提升至8K(3千萬畫素),影片解析度達5.7K;搭載晶片內影像拼接演算技術,讓消費者隨拍即看360全景相片/影片,也因為即時拼接的特性能支援360度影像在YouTube及Facebook等社群媒體直播,搭配VR頭盔更能體驗360度影像身歷其境的臨場感。今年更針對消費性市場展出一系列APP行動應用程式,包含人像追蹤/即時360直播推播&任意門/3D 360度照片等功能。

信驊科技董事長兼總經理林鴻明先生表示,自從去年Cupola360影像晶片開發送樣後開始與客戶討論並針對需求共同合作,積極拓展Cupola360產品線的應用,該公司不僅在消費性市場持續耕耘,也不斷跟客戶合作探索360度晶片在視訊會議及家用/公共監控等各種領域的發展,期能激盪出更多新的應用。

看好360度影像產業全球發展趨勢,信驊科技於2018年5月從伺服器基板管理控制器(BMC)產品跨足影像處理,正式發表Cupola360六鏡頭全景影像處理晶片,並進一步開發出360度攝影機參考設計,及完整APP行動應用軟體等,致力打造完整Cupola360生態圈,期促進360度攝影機與VR應用更加蓬勃。

擴展顯示生態系統 Arm推Mali-D77讓VR更真實

為普及虛擬實境(VR),Arm宣布推出全新Mali-D77顯示處理器IP,減少系統頻寬與功耗,為未來VR帶來更沉浸式的體驗與更流暢的效能,並消除暈眩感,為消費者帶來使用更友善、價格更親民的VR裝置。

Arm IP產品事業群總裁Rene Haas表示,Mali-D77將改變在整個SoC上對VR作業負載的思考。它帶來顯示解析度與幀率的顯著升級,並且能在行動VR頭戴式顯示器的功耗限制下達成。這將為更輕量、更小型、更舒適的VR裝置鋪路,並不受任何接線束縛,也會帶動消費級VR裝置的廣泛採用。

隨著消費者對於VR的興趣持續成長,對技術的要求也愈來愈高。雖然桌上型電腦得以提供強大的效能,卻仍限於有線的體驗。使用者期望能擁有更沉浸的體驗、更順暢的效能表現、不受接線牽絆且更輕量的裝置。然而想要開發出符合消費者渴望的效能水準、又不受接線牽絆的體驗,仍是一大挑戰,這其中的關鍵就是顯示技術。從視覺效果到延遲,都會為VR裝置定下基調,且延遲如果太明顯,就會導致暈眩。

Arm利用全新VR功能減少虛擬性、增加真實性,Mali-D77增加的全新VR加速功能,是讓它從市面上眾多顯示處理器脫穎而出的原因。舉例來說,把特定的運算從GPU移至DPU上,可以帶來更高品質的視覺效果,同時消除暈眩,釋放更多的 GPU 負載和相關的系統頻寬。Mali-D77其他關鍵強化功能還包括了鏡頭失真校正(Lens Distortion Correction, LDC)、色差校正(Chromatic Aberration Correction, CAC、非同步時間扭曲(Asynchronous Timewarp, ATW)等等。

Mali-D77同時也適合應用在其他的裝置、顯示器與使用案例上。例如,Mali-D77可以與現有的開發者生態系統整合至共同的SoC平台,從驅動一個VR頭戴顯示器,切換驅動另一個可顯示4K HDR場景的LCD/OLED螢幕,供行動裝置或家庭環境使用。因此,同樣的SoC可以用來解決不同的應用,而未來也可望協助讓VR裝置的價位更加親民。

高整合PMIC新功能發威 高密度運算應用小巧省電

虛擬實境系統

虛擬實境(VR)頭盔電路框圖如圖1所示。VR頭盔屬於高密度運算應用環境。圖像顯示要求專用的圖形處理器(GPU)和影像處理器(IPU)來增強用戶體驗。音訊處理部分則要求高速數位訊號處理器(DSP),而整個系統由中央處理器(CPU)協調。

圖1 VR頭盔電路框圖

VR系統需要經過優化的電源管理方案,以支援資料處理、通訊和感測器功能。負載是動態的,並趨向於使用更低的供電電壓,這對負載瞬態電壓的跌落要求將更加嚴格。由於處理器所在設備會包裹在頭部周圍,散熱成為選擇電源管理IC的另一個關鍵指標。

AP電源管理方案

圖2所示為典型的VR電源管理方案,以及系統運行所必需的協助工具。須要多路電壓輸出為CPU、記憶體及其他功能電路供電。即時時脈(RTC)和32kHz晶振(XTAL)支持高精確度計時。GPIO擴展器提高通斷控制靈活性以及模組和感測器管理。

圖2 典型AP電源管理

如果使用分離IC實現這些複雜功能,將面臨多方面巨大挑戰:

1.AP系統要求嚴格的上電順序,以便在電壓和溫度變化條件下成功啟動。這一要求很容易造成系統被過度保護、體積龐大。

2.如果在正常工作期間遭遇系統或穩壓器故障,系統必須能夠發出處理器報警並確定下一步操作。這種優先順序和順序檢測至關重要。

3.較大的方案面積、較長的PCB走線將對穩壓器效率產生不利影響,縮短設備的執行時間,增加系統發熱程度。

4.分離式設計方案增加了電路板的元件數量,事實證明這種情況會因為裝配問題造成較高故障率,以及較差的訊號完整性。

5.分離式方案中使用IC非常多,占用更多的I2C匯流排資源,造成額外的處理器資訊讀取延遲。

整合方案

全整合方案能夠克服分離式電源配置所面臨的挑戰。圖3所示為單晶片整合PMIC為AP供電的示意圖,可有效減小PCB尺寸、重量和體積,且不會犧牲效能。

圖3 全整合式AP電源管理

MAX77714為完備的電源管理IC,特別適合運用於系統單晶片(SoC)應用處理器功能。兩路大電流降壓調節器(SD0和SD1)優化用於AP的CPU和GPU供電,且輸出電壓支援動態電壓調節(DVS),範圍為0.26V~1.52V。輸出級MOSFET的RDS(ON)經過優化,提供優異的轉換效率,如圖4靜態分析所示。這些調節器也支援強制脈寬調變技術,大幅降低輕載條件下的紋波。另外兩路調節器(SD2和SD3)具有較寬的輸出範圍,通用性更強。全部四路開關穩壓器均具有內部補償,將外部元件需求降至最低。

圖4 效率優勢

MAX77714還提供9路可靈活配置的低壓差(LDO)線性穩壓器,電流範圍為150mA~450mA,適用於系統的雜訊敏感電路供電。全部LDO都具有兩種軟啟動速率,以限制啟動期間的浪湧電流,支援較寬的輸出電壓範圍。8個GPIO接腳可靈活配置。其中4個GPIO接腳可配置用作電源排序(FPS)控制,3個GPIO接腳可配置為32kHz時脈輸出,用於同步外部系統。最後,第8個GPIO接腳則可配置為系統喚醒接腳。

即時時脈配合外部晶振工作,提供計時和喚醒功能。如果不使用該功能,則可使用內部矽振盪器,以節省BOM成本。可靠的開/關控制狀態機驅動FPS實現上電/斷電、故障處理和電源模式控制,最大程度減少AP的介入。此外,整合看門狗計時器用於系統監測,避免AP操作掛起狀態。

PMIC採用70焊球、4.1mm×3.25mm

×0.7mm、0.4mm焊距晶圓級封裝(WLP),是空間受限應用的理想選擇;此外,較高的工作頻率允許使用小尺寸被動元件,最終獲得PCB面積僅為230mm2的總體方案(圖5)。

圖5 PCB 230mm2

PMIC具有多個可配置暫存器,可以透過I2C進行自訂,實現眾多產品的量身定制。

虛擬實境應用中的AP供電在靈活性、效率和尺寸方面都帶來了諸多設計挑戰。高度整合的PMIC方案提供靈活配置,非常適合各種空間受限的應用處理器供電。低RDS(ON) FET提供優異的轉換效率,同時高頻工作允許使用小尺寸被動元件,進一步降低PCB尺寸和成本。

(本文作者為Maxim半導體工程師)